AI導入の課題を解決する日本発の設計指針『EVΛƎ』の全貌とは

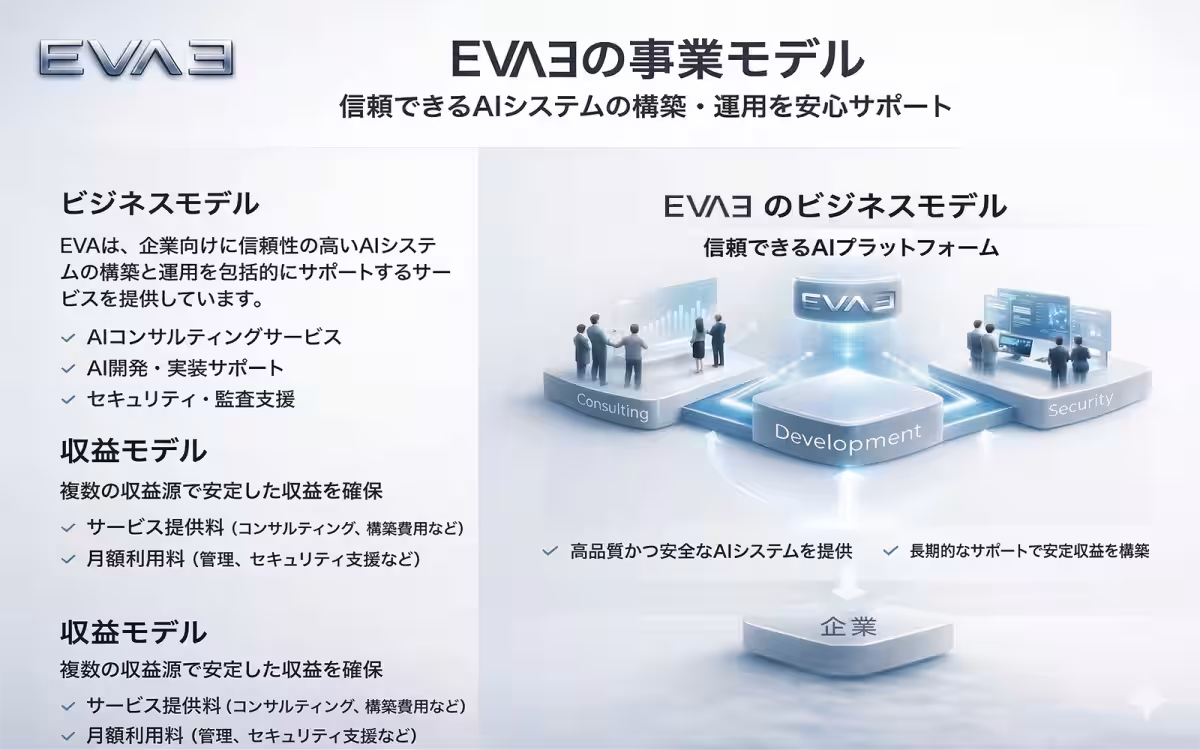

AI導入の課題を解決するための『EVΛƎ』

AIの導入が進む現代において、私たちの生活や産業に大きく影響を与えています。しかしながら、AIを利用する際には、いくつかの課題が浮かび上がっています。特に、利用者がAIの判断に対してどれだけの信頼を持てるかが懸念されているのです。そこで登場するのが、アミュレットプラス合同会社が開発した日本発の設計指針「EVΛƎ(エヴァ)」です。

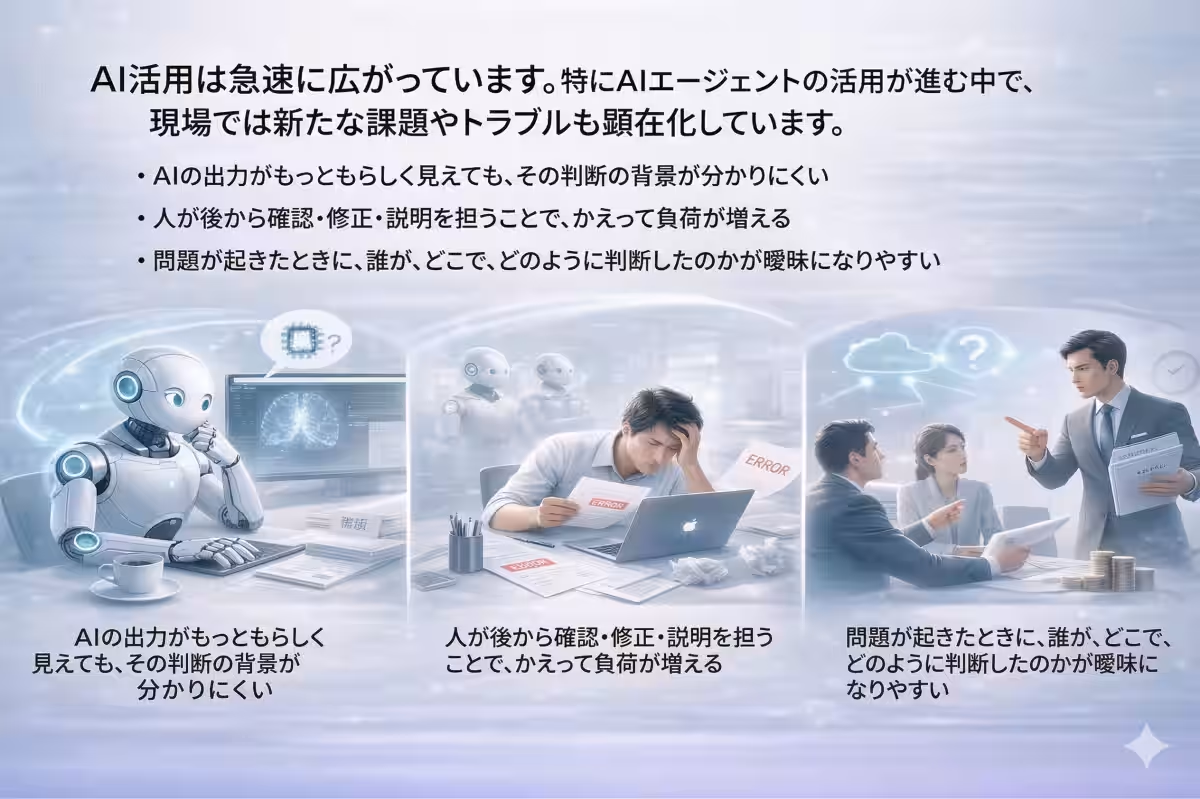

AI導入がもたらす新たな課題

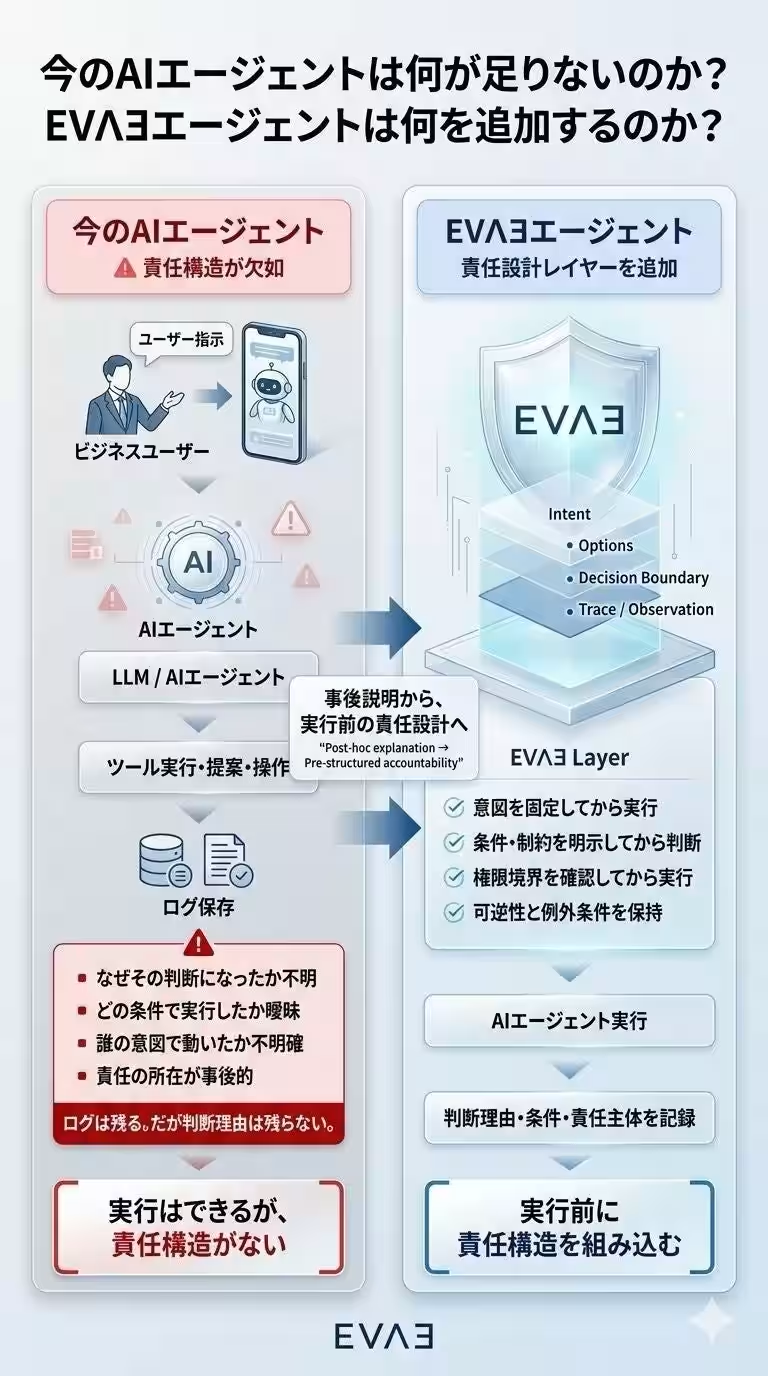

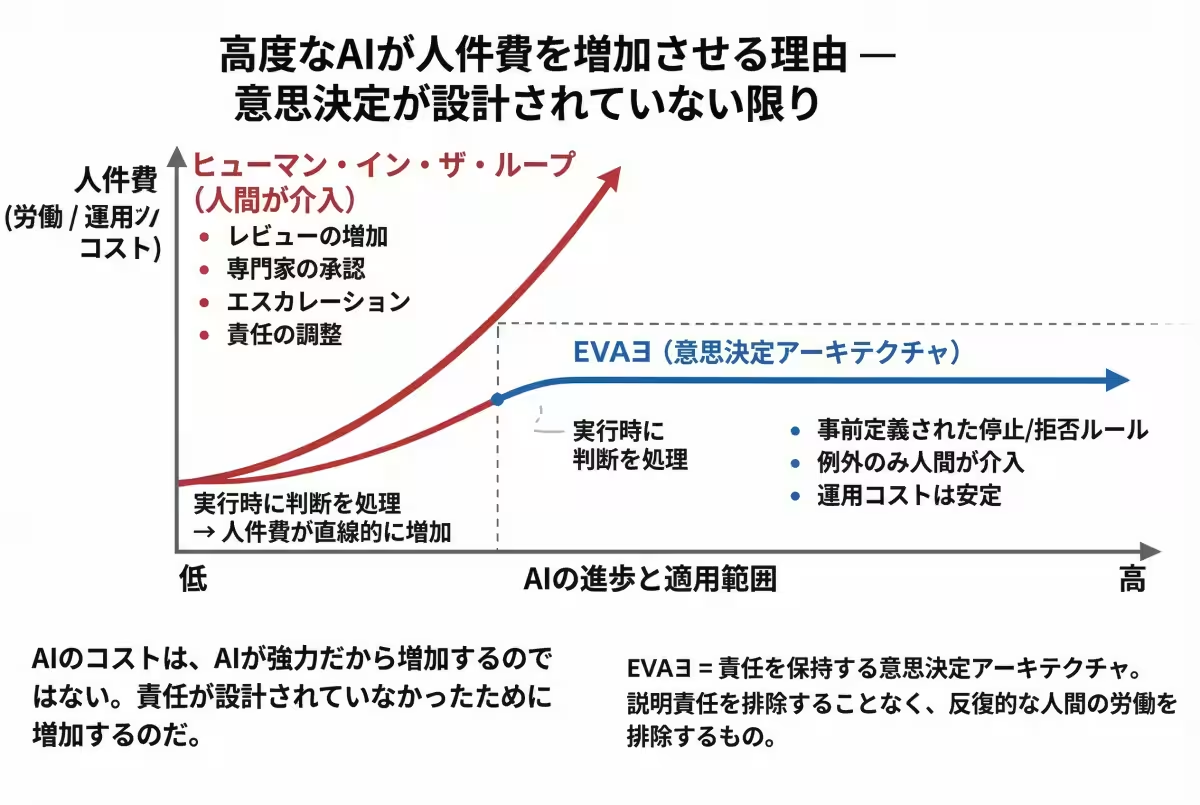

近年、特にAIエージェントの普及が加速するなか、現場で直面する新たな課題も増加しています。その中でも顕著なのは、AIが出力する結果が信じられるものかどうかということです。多くの場合、AIの判断根拠は不明確で、これが人間に対して余分な負担を与えています。

- - 判断の透明性の欠如:AIが出力した結論の背景が分からないため、どのようにその結論に至ったのかが理解できません。

- - 確認と修正の増加:AIの判断に対して人間が後から確認し、修正する必要が生じることで、逆に作業が増加してしまいます。

- - 責任の所在が不明瞭:問題発生時に、誰がどのように判断したのかが曖昧になる場面が多発しています。

これらの問題は単なる運用上の課題ではなく、AIが動く前の意思決定の構造が不足していることに起因しています。

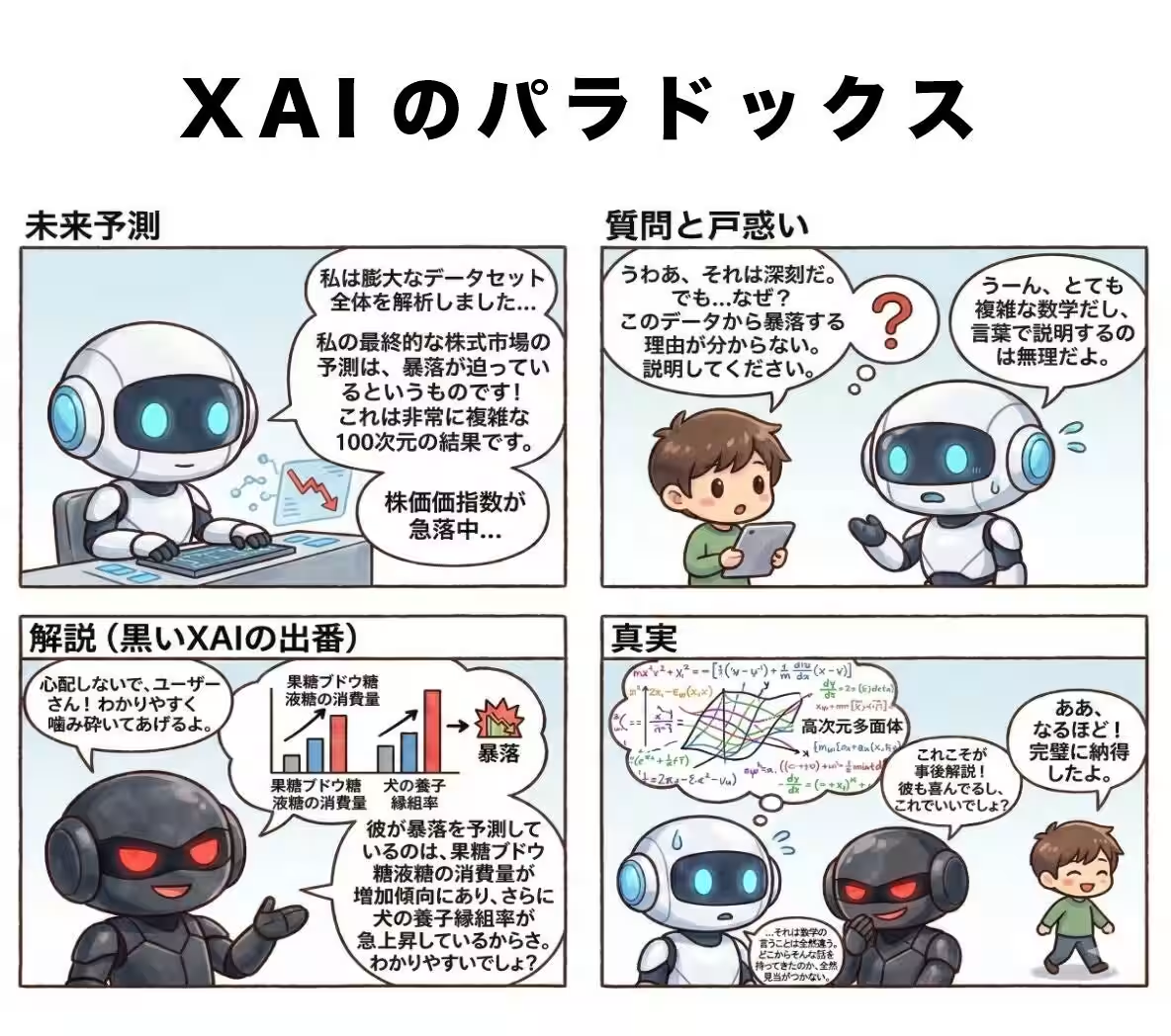

AIガバナンスの重要性

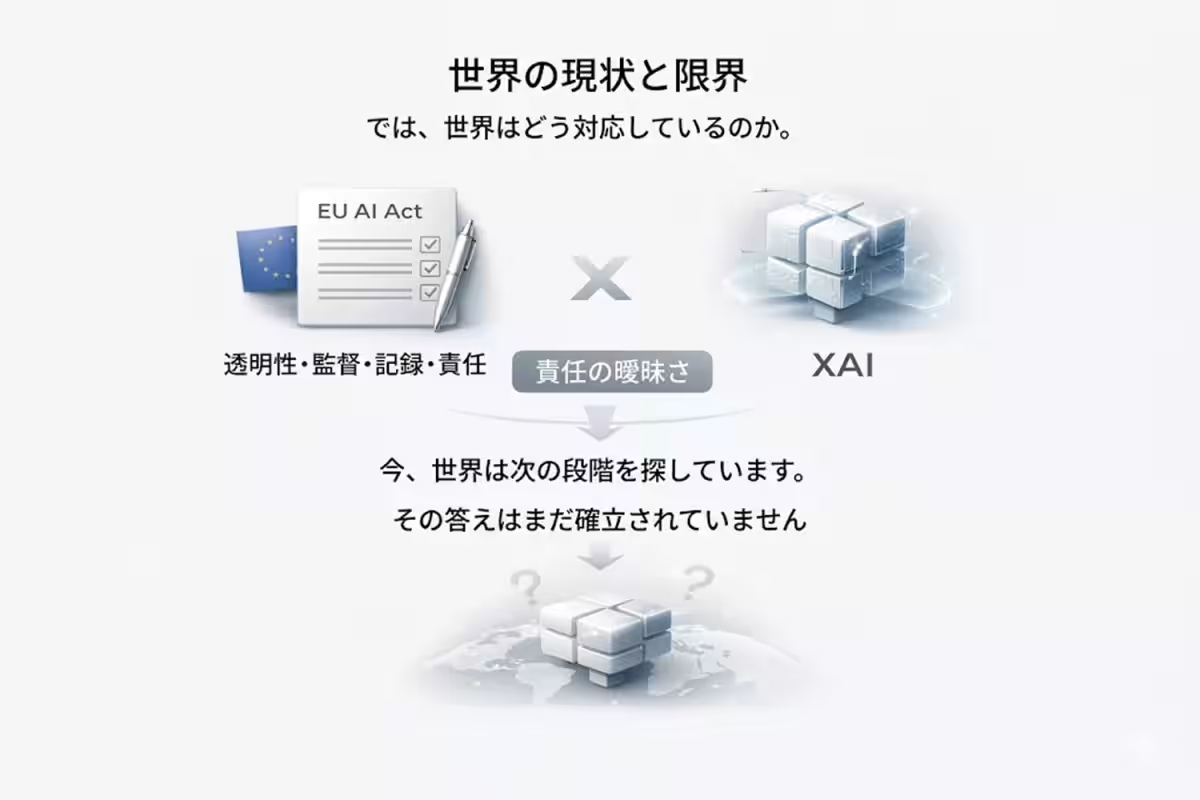

AIがどのように機能するかを管理する「AIガバナンス」の必要性はますます高まっています。しかし、現行のガバナンス体制は、実際にAIが動く前に権限や責任を明確化する仕組みが不十分のままです。

この背景には、AIの実行前に「誰が決定をするか」「どこでそれをストップさせるか」といった要素がしっかりと構造化されていないという課題があります。この未開拓な領域こそが、AI社会における大きな空白であり、責任が人間に集中してしまう原因となっています。

『Design by Transparency』の理念

アミュレットプラス合同会社が提唱する「Design by Transparency」の理念は、AIが動いた後に説明をつけるのではなく、動く前に意思決定に必要な要素を明らかにすることにあります。

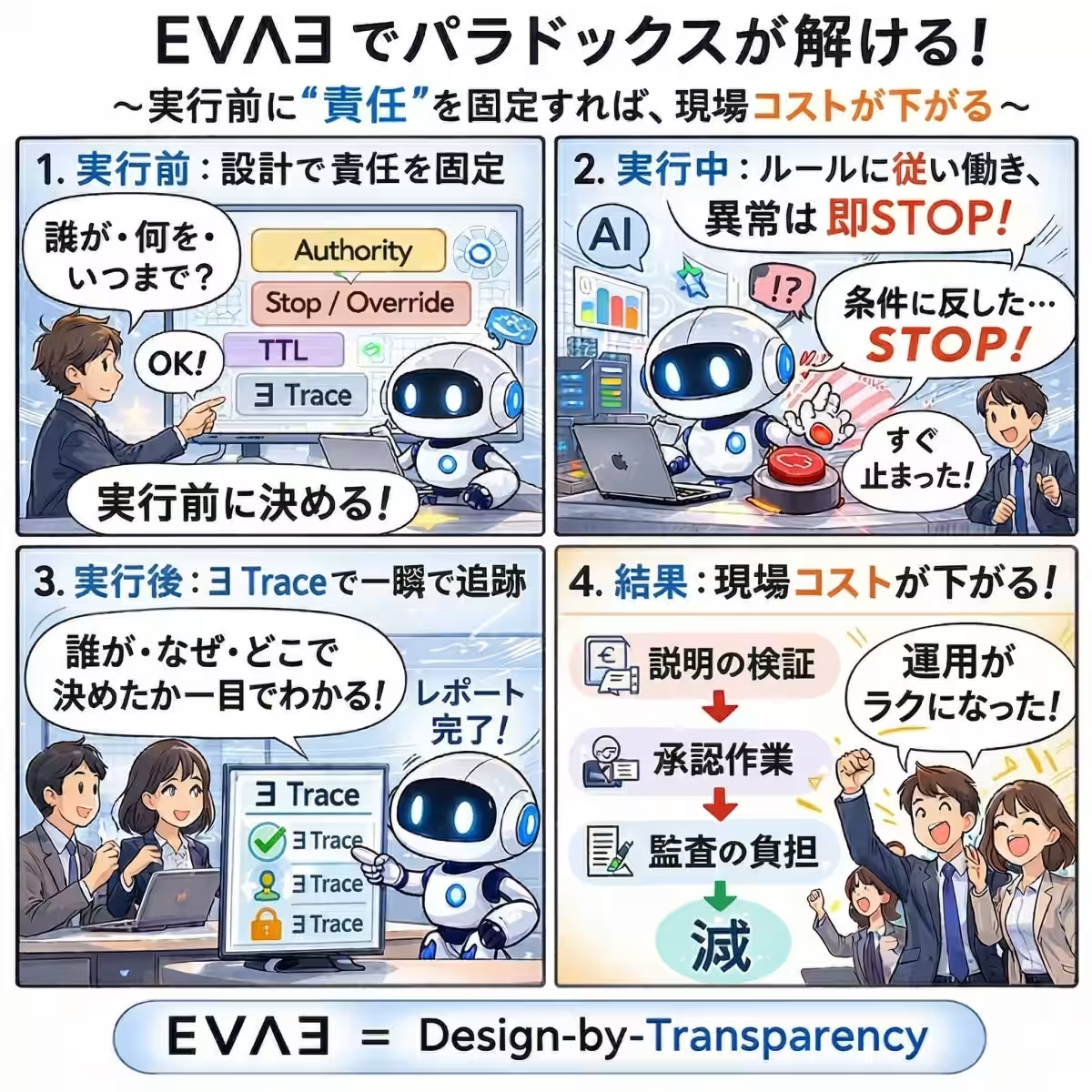

この設計考え方の中核が「EVΛƎ」です。EVΛƎでは、AIの実行前に以下の要素を明確にします。

- - 意図(Intent):その判断の目的。

- - 権限(Authority):誰が決定を下すのか。

- - 制約(Constraint):何を行ってはいけないのか。

- - 観測(Observation):どのように記録をし、責任の証拠を残すのか。

これにより、AIが人間の意志を適切に反映できるよう、責任が明確化されます。

具体的な適用事例

AIの判断が必要とされる医療や教育の現場では、この設計指針が特に重要です。例えば医療の分野では、AIの判断が自動的に実行されるのではなく、必ず医師の承認を得てから進む仕組みを整備することが求められます。これにより、AIは責任を持った判断をすることが可能になります。

未来のビジョン

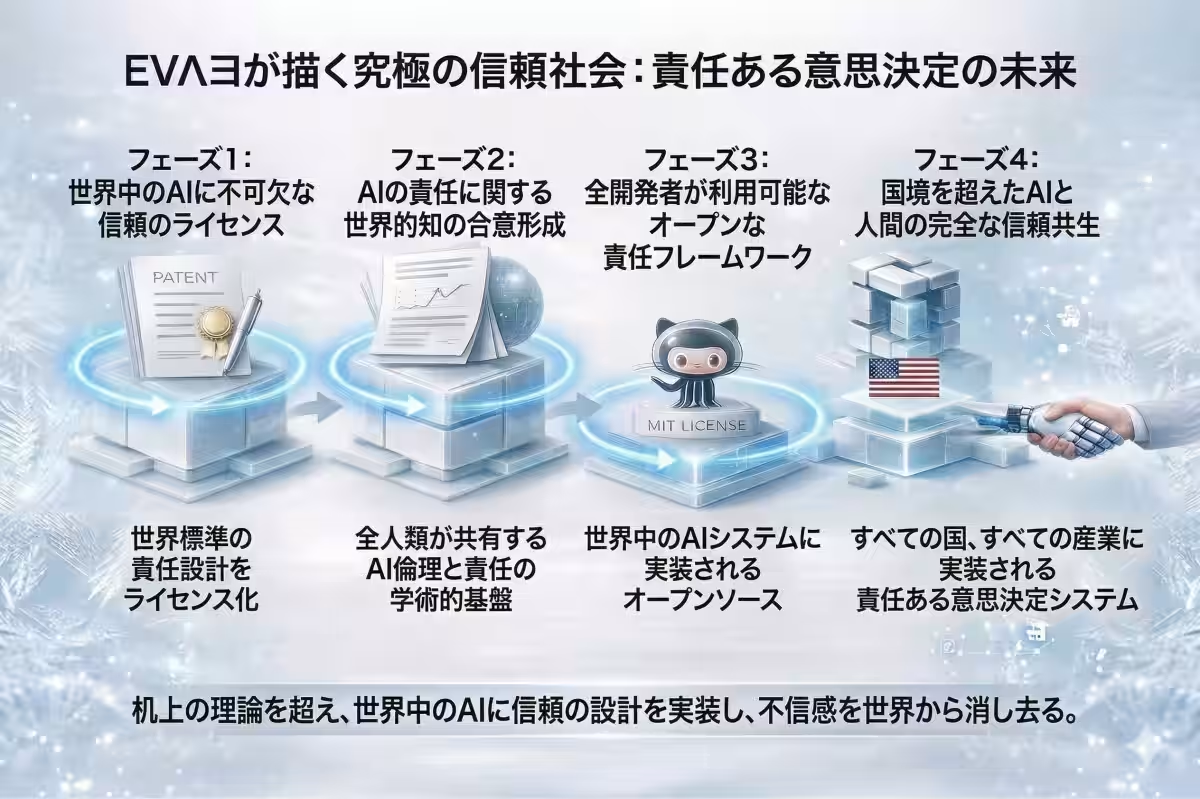

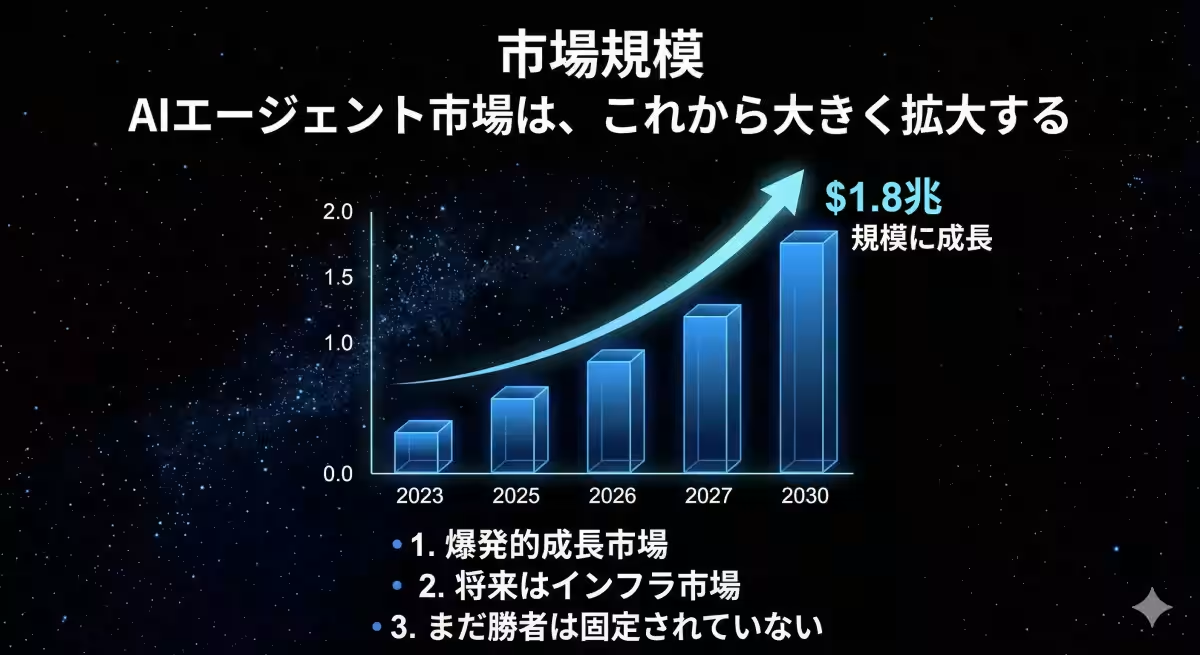

アミュレットプラスの目指すビジョンは、2030年までに「Design by Transparency」の理念をすべてのAIシステムに浸透させることです。これにより、AIはより信頼される存在となり、責任のもとで活用される未来が実現されます。私たちは、日本発の設計思想を通じて、利便性だけでなく、社会に必要とされる信頼性をもたらすAIを目指し続けます。

最後に、AIと人が協力して働ける社会を共に築くため、共感するパートナーを募集中です。私たちの力を合わせて、「信頼の未来」を創っていきましょう。

トピックス(その他)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。