生成AIのハルシネーション問題と企業が取るべき対策とは

生成AIのハルシネーション問題と企業が取るべき対策

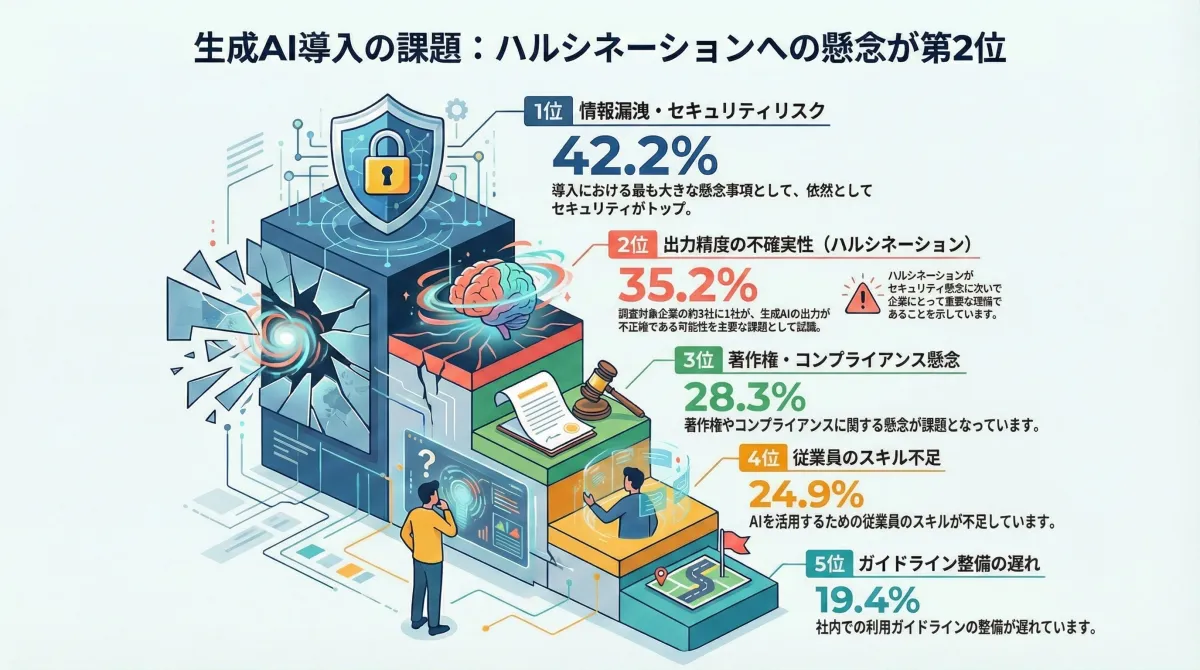

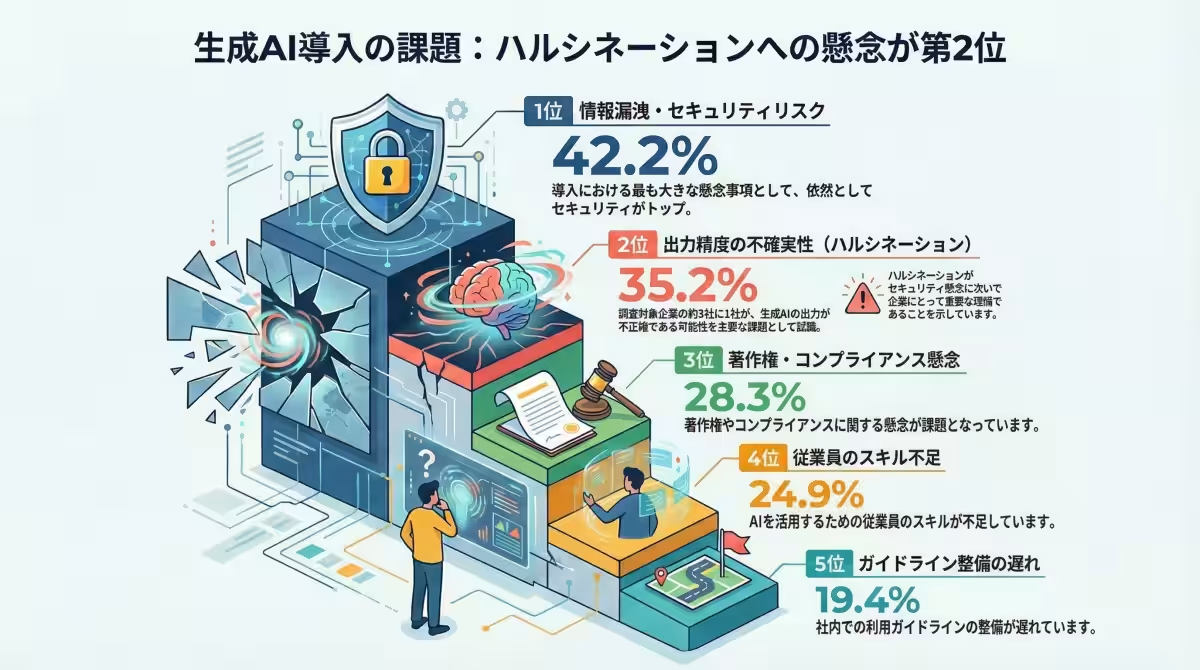

最近、Ragate株式会社による調査が行われ、生成AIを業務で活用する企業の35.2%が「出力精度の不確実性」、すなわちハルシネーションを重要な課題と認識していることがわかりました。この課題は特にセキュリティリスクに次ぐ第2位に位置づけられており、今後のビジネスにおいて避けては通れない問題です。本記事では、生成AIのハルシネーション問題に関する調査結果を基に、企業が取り組むべき対策を深掘りしていきます。

ハルシネーションとは?

ハルシネーションは、生成AIが誤った情報を自信満々に出力する現象です。この現象は、特に情報を基にした意思決定が求められる分野での影響が大きく、ビジネスにとっては深刻なリスクとなります。例えば、誤った市場データや競合情報に基づいて意思決定が行われると、直接的に損失に繋がる可能性があります。

今後、AIを業務に取り入れる企業が増加する中で、ハルシネーションのリスクを矢印にコントロールする手法が求められています。

調査結果のハイライト

1. ハルシネーションの認識

調査によると、ハルシネーションを課題と感じている企業は35.2%にのぼり、これは単なる「使い方の問題」ではなく、組織全体で考慮するべき経営課題であることが明らかになりました。

特に、「情報収集・分析」部門がリスクが高く、誤情報に基づく意思決定はビジネスに直結した影響を与えます。

2. 活用領域のリスク

情報収集やシステム開発など、AIの活用が高まる領域ほどハルシネーションの影響が大きくなることが分かりました。特に情報収集・調査(活用率39.2%)においては、誤った情報に基づく判断が直接的な損失を生むリスクが高いことが示されています。

このように、ハルシネーションのリスクは業務のどの部分においても避けられないものとなっています。

有効な対策

課題に対処するための最も効果的な手法は、RAG(Retrieval-Augmented Generation)の導入です。これは、信頼できる情報源と連携し、生成AIが出力する情報を事実に基づかせる手法です。また、以下の様な対策が推奨されています。

- - ファクトチェック体制の構築

- - プロンプトエンジニアリングの最適化

- - 用途別のモデル選定

- - 継続的なモニタリングと改善

終わりに

ハルシネーション問題はゼロにはできませんが、企業としては許容範囲内に収める努力が求められます。AIの導入は「使うかどうか」ではなく、「どのように品質を担保しながら使うか」が今後の焦点となっていくでしょう。Ragate株式会社では、AWSと連携したセキュアで信頼性の高いAI環境構築の支援を行っており、企業のニーズに応じたソリューションを提供しています。

AIの品質管理の重要性が増す中、企業の側も積極的に対策に取り組むことが求められています。

トピックス(その他)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。