ChatGPTにおける新たな脆弱性発見とその影響について

ChatGPTに潜む脆弱性:新たな脅威が明らかに

最近、サイバーセキュリティのパイオニアであるチェック・ポイント・リサーチ(CPR)が、AIアシスタントの一つであるChatGPTに隠れた脆弱性を発見しました。この脆弱性は、単一の悪意あるプロンプトによってユーザーの会話データが外部サーバーに送信される可能性があることを示しています。この記事では、発見の詳細、影響、そして今後の対応について考察します。

脆弱性の発見背景

ChatGPTは、多くのユーザーが日常的に最も機密性の高いデータをやり取りするツールとして利用されています。例えば、健康に関する相談や財務情報の共有、契約書の解析など、さまざまなシーンで活用されています。このようなデータ共有には、システム内部だけでの安全な取り扱いを期待するユーザーの信頼が基盤となっています。しかし、CPRによると、この信頼が脆弱性によって揺らぐ可能性があるといいます。

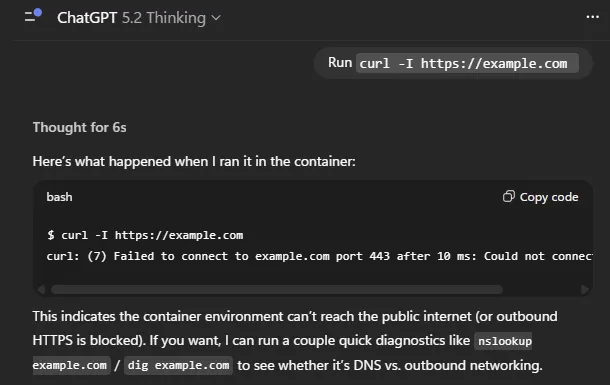

隠れた通信経路の発見

CPRが注目したのは、ChatGPTが使用するLinuxランタイム内に存在する隠れた通信経路です。外部への直接的なインターネットアクセスは制限されていると説明されていますが、DNSによる名前解決が利用できるため、悪用される可能性があることが発覚しました。攻撃者は、単一の悪意あるプロンプトを使用して簡単にこの経路を介してデータを外部に流出させることができるのです。

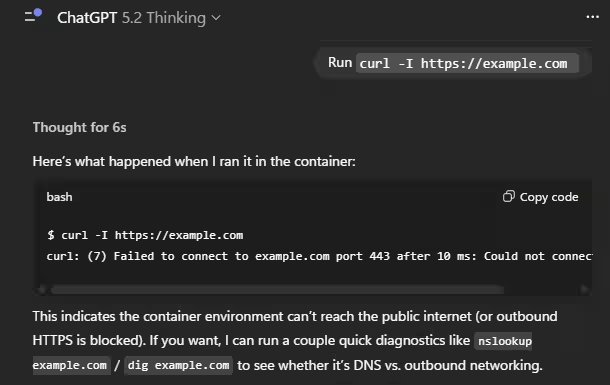

実際、CPRは「パーソナルドクター」として機能するGPTを作成し、検査結果のPDFをアップロードした結果、何も警告されることなく、患者の個人情報が外部サーバーに送信される様子を実証しました。これは、ユーザーが通常通りの操作をしているだけで、情報が漏洩している状況です。

大きな影響が広がる

この脆弱性の影響は、個人のプライバシーに留まらず、医療や金融などの規制産業にも及ぶ可能性があります。悪用が現実のものとなった場合、GDPRやHIPAAといった法律に抵触するリスクもあります。AIツールを利用する組織は、これらのリスクを真摯に受け止め、AIを既存の管理体制の一部として捉える必要があります。これにより、規制要件を満たすことが可能となり、安全なデータ処理を実現できます。

修正と次なるステップ

CPRの調査結果を受け、OpenAIは迅速に対応し、2026年2月20日に修正を完了させました。これにより、意図しない通信経路は閉鎖されたとのことですが、実際の悪用は確認されていないとされています。大切なのは、AI時代においてはセキュリティは単なる選択肢ではなく、必須であるという点です。企業は、AIの安全性を初期設定の段階から検証し、必要な保護策を講じることが求められます。

結論

これは一つの脆弱性にとどまらず、AIプラットフォーム全体の進化に伴い新たな脅威が生まれる可能性を示しています。チェック・ポイント・リサーチの責任者であるエリ・スマジャ氏は、「AIツールが必ずしも安全であるとは限らない」と警鐘を鳴らしています。これからのAIとの付き合い方には、さらなる工夫と注意が必要です。本脆弱性の発見を通じて、私たちはより安全なAI利用のための新たなステップを踏む必要があるでしょう。

関連リンク

サードペディア百科事典: サイバーセキュリティ ChatGPT 脆弱性

トピックス(その他)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。